中文 | 한국어 | 日本語 | Русский | Deutsch | Français | Español | Português | Türkçe | Tiếng Việt | العربية

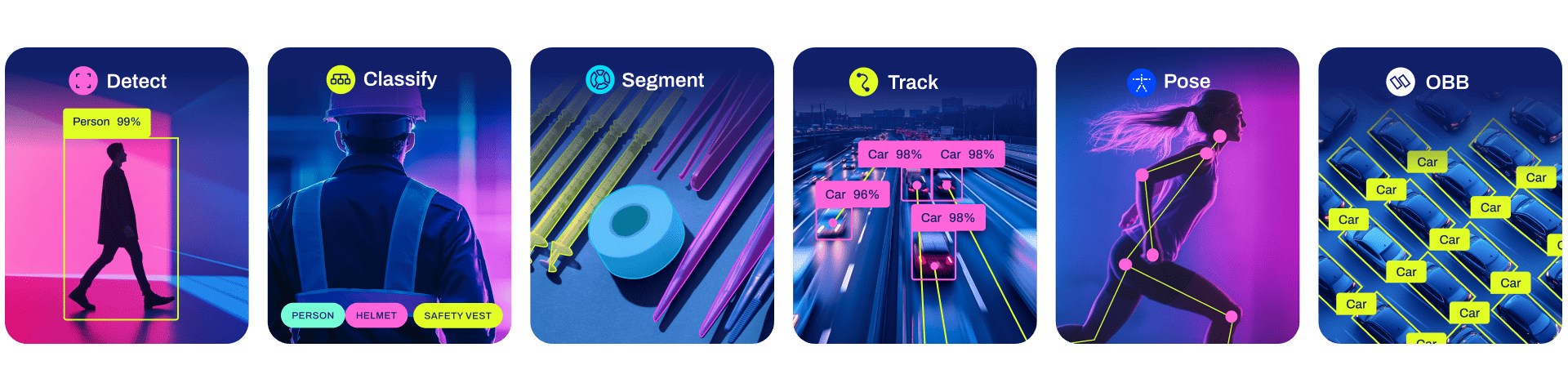

Ultralytics YOLO11 是一个尖端的、最先进(SOTA)的模型,基于之前 YOLO 版本的成功,并引入了新功能和改进以进一步提升性能和灵活性。YOLO11 被设计得快速、准确且易于使用,是进行广泛对象检测和跟踪、实例分割、图像分类和姿态估计任务的理想选择。

我们希望这里的资源能帮助你充分利用 YOLO。请浏览 Ultralytics 文档 以获取详细信息,在 GitHub 上提出问题或讨论,成为 Ultralytics Discord、Reddit 和 论坛 的成员!

想申请企业许可证,请完成 Ultralytics Licensing 上的表单。

文档

请参阅下方的快速开始安装和使用示例,并查看我们的 文档 以获取有关训练、验证、预测和部署的完整文档。

安装

在 Python>=3.8 环境中使用 PyTorch>=1.8 通过 pip 安装包含所有依赖项 的 ultralytics 包。

pip install ultralytics

使用

CLI

YOLO 可以直接在命令行接口(CLI)中使用 yolo 命令:

yolo predict model=yolo11n.pt source='https://ultralytics.com/images/bus.jpg'

yolo 可以用于各种任务和模式,并接受额外参数,例如 imgsz=640。请参阅 YOLO CLI 文档 以获取示例。

Python

YOLO 也可以直接在 Python 环境中使用,并接受与上述 CLI 示例中相同的参数:

from ultralytics import YOLO

# 加载模型

model = YOLO("yolo11n.pt")

# 训练模型

train_results = model.train(

data="coco8.yaml", # 数据集 YAML 路径

epochs=100, # 训练轮次

imgsz=640, # 训练图像尺寸

device="cpu", # 运行设备,例如 device=0 或 device=0,1,2,3 或 device=cpu

)

# 评估模型在验证集上的性能

metrics = model.val()

# 在图像上执行对象检测

results = model("path/to/image.jpg")

results[0].show()

# 将模型导出为 ONNX 格式

path = model.export(format="onnx") # 返回导出模型的路径

请参阅 YOLO Python 文档 以获取更多示例。

模型

YOLO11 检测、分割 和 姿态 模型在 COCO 数据集上进行预训练,这些模型可在此处获得,此外还有在 ImageNet 数据集上预训练的 YOLO11 分类 模型。所有检测、分割和姿态模型均支持 跟踪 模式。

所有模型在首次使用时自动从最新的 Ultralytics 发布下载。

检测 (COCO)

请参阅 检测文档 以获取使用这些在 COCO 数据集上训练的模型的示例,其中包含 80 个预训练类别。

| 模型 | 尺寸 (像素) |

mAPval 50-95 |

速度 CPU ONNX (ms) |

速度 T4 TensorRT10 (ms) |

参数 (M) |

FLOPs (B) |

|---|---|---|---|---|---|---|

| YOLO11n | 640 | 39.5 | 56.1 ± 0.8 | 1.5 ± 0.0 | 2.6 | 6.5 |

| YOLO11s | 640 | 47.0 | 90.0 ± 1.2 | 2.5 ± 0.0 | 9.4 | 21.5 |

| YOLO11m | 640 | 51.5 | 183.2 ± 2.0 | 4.7 ± 0.1 | 20.1 | 68.0 |

| YOLO11l | 640 | 53.4 | 238.6 ± 1.4 | 6.2 ± 0.1 | 25.3 | 86.9 |

| YOLO11x | 640 | 54.7 | 462.8 ± 6.7 | 11.3 ± 0.2 | 56.9 | 194.9 |

- mAPval 值针对单模型单尺度在 COCO val2017 数据集上进行。

复制命令yolo val detect data=coco.yaml device=0 - 速度在使用 Amazon EC2 P4d 实例的 COCO 验证图像上平均。

复制命令yolo val detect data=coco.yaml batch=1 device=0|cpu

分割 (COCO)

请参阅 分割文档 以获取使用这些在 COCO-Seg 数据集上训练的模型的示例,其中包含 80 个预训练类别。

| 模型 | 尺寸 (像素) |

mAPbox 50-95 |

mAPmask 50-95 |

速度 CPU ONNX (ms) |

速度 T4 TensorRT10 (ms) |

参数 (M) |

FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO11n-seg | 640 | 38.9 | 32.0 | 65.9 ± 1.1 | 1.8 ± 0.0 | 2.9 | 10.4 |

| YOLO11s-seg | 640 | 46.6 | 37.8 | 117.6 ± 4.9 | 2.9 ± 0.0 | 10.1 | 35.5 |

| YOLO11m-seg | 640 | 51.5 | 41.5 | 281.6 ± 1.2 | 6.3 ± 0.1 | 22.4 | 123.3 |

| YOLO11l-seg | 640 | 53.4 | 42.9 | 344.2 ± 3.2 | 7.8 ± 0.2 | 27.6 | 142.2 |

| YOLO11x-seg | 640 | 54.7 | 43.8 | 664.5 ± 3.2 | 15.8 ± 0.7 | 62.1 | 319.0 |

- mAPval 值针对单模型单尺度在 COCO val2017 数据集上进行。

复制命令yolo val segment data=coco-seg.yaml device=0 - 速度在使用 Amazon EC2 P4d 实例的 COCO 验证图像上平均。

复制命令yolo val segment data=coco-seg.yaml batch=1 device=0|cpu

分类 (ImageNet)

请参阅 分类文档 以获取使用这些在 ImageNet 数据集上训练的模型的示例,其中包含 1000 个预训练类别。

| 模型 | 尺寸 (像素) |

acc top1 |

acc top5 |

速度 CPU ONNX (ms) |

速度 T4 TensorRT10 (ms) |

参数 (M) |

FLOPs (B) at 640 |

|---|---|---|---|---|---|---|---|

| YOLO11n-cls | 224 | 70.0 | 89.4 | 5.0 ± 0.3 | 1.1 ± 0.0 | 1.6 | 3.3 |

| YOLO11s-cls | 224 | 75.4 | 92.7 | 7.9 ± 0.2 | 1.3 ± 0.0 | 5.5 | 12.1 |

| YOLO11m-cls | 224 | 77.3 | 93.9 | 17.2 ± 0.4 | 2.0 ± 0.0 | 10.4 | 39.3 |

| YOLO11l-cls | 224 | 78.3 | 94.3 | 23.2 ± 0.3 | 2.8 ± 0.0 | 12.9 | 49.4 |

| YOLO11x-cls | 224 | 79.5 | 94.9 | 41.4 ± 0.9 | 3.8 ± 0.0 | 28.4 | 110.4 |

- acc 值为在 ImageNet 数据集验证集上的模型准确率。

复制命令yolo val classify data=path/to/ImageNet device=0 - 速度在使用 Amazon EC2 P4d 实例的 ImageNet 验证图像上平均。

复制命令yolo val classify data=path/to/ImageNet batch=1 device=0|cpu

姿态 (COCO)

请参阅 姿态文档 以获取使用这些在 COCO-Pose 数据集上训练的模型的示例,其中包含 1 个预训练类别(人)。

| 模型 | 尺寸 (像素) |

mAPpose 50-95 |

mAPpose 50 |

速度 CPU ONNX (ms) |

速度 T4 TensorRT10 (ms) |

参数 (M) |

FLOPs (B) |

|---|---|---|---|---|---|---|---|

| YOLO11n-obb | 1024 | 78.4 | 117.6 ± 0.8 | 4.4 ± 0.0 | 2.7 | 17.2 | |

| YOLO11s-obb | 1024 | 79.5 | 219.4 ± 4.0 | 5.1 ± 0.0 | 9.7 | 57.5 | |

| YOLO11m-obb | 1024 | 80.9 | 562.8 ± 2.9 | 10.1 ± 0.4 | 20.9 | 183.5 | |

| YOLO11l-obb | 1024 | 81.0 | 712.5 ± 5.0 | 13.5 ± 0.6 | 26.2 | 232.0 | |

| YOLO11x-obb | 1024 | 81.3 | 1408.6 ± 7.7 | 28.6 ± 1.0 | 58.8 | 520.2 |

- mAPval 值针对单模型单尺度在 COCO Keypoints val2017 数据集上进行。

复制命令yolo val pose data=coco-pose.yaml device=0 - 速度在使用 Amazon EC2 P4d 实例的 COCO 验证图像上平均。

复制命令yolo val pose data=coco-pose.yaml batch=1 device=0|cpu

OBB (DOTAv1)

请参阅 OBB 文档 以获取使用这些在 DOTAv1 数据集上训练的模型的示例,其中包含 15 个预训练类别。

| 模型 | 尺寸 (像素) |

mAPtest 50 |

速度 CPU ONNX (ms) |

速度 T4 TensorRT10 (ms) |

参数 (M) |

FLOPs (B) |

|---|---|---|---|---|---|---|

| YOLO11n-obb | 1024 | 78.4 | 117.56 ± 0.80 | 4.43 ± 0.01 | 2.7 | 17.2 |

| YOLO11s-obb | 1024 | 79.5 | 219.41 ± 4.00 | 5.13 ± 0.02 | 9.7 | 57.5 |

| YOLO11m-obb | 1024 | 80.9 | 562.81 ± 2.87 | 10.07 ± 0.38 | 20.9 | 183.5 |

| YOLO11l-obb | 1024 | 81.0 | 712.49 ± 4.98 | 13.46 ± 0.55 | 26.2 | 232.0 |

| YOLO11x-obb | 1024 | 81.3 | 1408.63 ± 7.67 | 28.59 ± 0.96 | 58.8 | 520.2 |

- mAPtest 值针对单模型多尺度在 DOTAv1 数据集上进行。

复制命令yolo val obb data=DOTAv1.yaml device=0 split=test并提交合并结果到 DOTA 评估。 - 速度在使用 Amazon EC2 P4d 实例的 DOTAv1 验证图像上平均。

复制命令yolo val obb data=DOTAv1.yaml batch=1 device=0|cpu

集成

我们与领先的 AI 平台的关键集成扩展了 Ultralytics 产品的功能,增强了数据集标记、训练、可视化和模型管理等任务的能力。了解 Ultralytics 如何与 Roboflow、ClearML、Comet、Neural Magic 和 OpenVINO 合作,优化您的 AI 工作流程。

| Roboflow | ClearML ⭐ NEW | Comet ⭐ NEW | Neural Magic ⭐ NEW |

|---|---|---|---|

| Label and export your custom datasets directly to YOLO11 for training with Roboflow | Automatically track, visualize and even remotely train YOLO11 using ClearML (open-source!) | Free forever, Comet lets you save YOLO11 models, resume training, and interactively visualize and debug predictions | Run YOLO11 inference up to 6x faster with Neural Magic DeepSparse |

Ultralytics HUB

体验无缝 AI 使用 Ultralytics HUB ⭐,一个集数据可视化、YOLO11 🚀 模型训练和部署于一体的解决方案,无需编写代码。利用我们最先进的平台和用户友好的 Ultralytics 应用,将图像转换为可操作见解,并轻松实现您的 AI 愿景。免费开始您的旅程!

贡献

我们欢迎您的意见!没有社区的帮助,Ultralytics YOLO 就不可能实现。请参阅我们的 贡献指南 开始,并填写我们的 调查问卷 向我们提供您体验的反馈。感谢所有贡献者 🙏!

许可

Ultralytics 提供两种许可选项以适应各种用例:

- AGPL-3.0 许可:这是一个 OSI 批准 的开源许可,适合学生和爱好者,促进开放协作和知识共享。有关详细信息,请参阅 LICENSE 文件。

- 企业许可:专为商业使用设计,此许可允许将 Ultralytics 软件和 AI 模型无缝集成到商业产品和服务中,无需满足 AGPL-3.0 的开源要求。如果您的场景涉及将我们的解决方案嵌入到商业产品,请通过 Ultralytics Licensing 联系我们。

联系

如需 Ultralytics 的错误报告和功能请求,请访问 GitHub Issues。成为 Ultralytics Discord、Reddit 或 论坛 的成员,提出问题、分享项目、探讨学习讨论,或寻求所有 Ultralytics 相关的帮助!